Elitäre Cloud-Management-Tools Die besten Multi-Cloud-Orchestrierer

Die reibungslose Workload-Bereitstellung in der Multi-Cloud stellt Unternehmen vor neue Herausforderungen. Anbieter kommerzieller Container-Orchestrierer wollen sich nützlich machen. Der Goldrausch ist in vollem Schwung.

Anbieter zum Thema

Viele Unternehmen haben ihre Workloads bereits längst auf Microservices umgestellt, um die Skalierbarkeit ihrer Anwendungen und damit die Kosten in den Griff zu bekommen. Was der Mehrheit dieser Cloud-Nutzer fehlt, ist die Kontrolle über ihre Ausführungsumgebung.

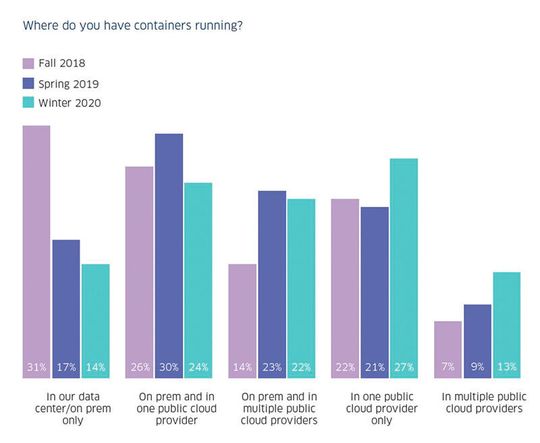

Das Konzept der Multi-Cloud scheint sich dennoch zu bewähren. Laut der 2020 Cloud Computing Survey von IDG nutzt knapp eine von drei (29 Prozent) der befragten Organisationen schwerpunktmäßig die Cloud, ohne jedoch auf die unternehmenseigene IT vor Ort ganz verzichtet zu haben. Nur 8 Prozent der Firmen versorgen sich ausschließlich vor Ort. Rund jede zweite der befragten Organisationen (55 Prozent) nutzt mehr als eine Public Cloud; jedes fünfte der Unternehmen nimmt die Dienste von drei oder mehr Cloud-Anbietern in Anspruch.

Eine Studie der Enterprise Strategy Group (ESG) unter mehr als 1.250 IT-Entscheidern in großen und mittleren Unternehmen weltweit gelangte vor einigen Monaten zu ähnlichen Ergebnissen. Demnach lagern 58 Prozent der Unternehmen ihre Workloads in eine oder mehrere Public Clouds aus. Nicht nur kommen die meisten dieser Organisationen mit einem einzelnen Anbieter nicht aus, sondern betreiben zusätzlich noch eine Private-Cloud im unternehmenseigenen Datencenter und bauen ihre On-Premises-Umgebung sogar noch weiter aus. Die Multi-Cloud ist klar auf dem Vormarsch.

Risikostreuung sichert Verfügbarkeit

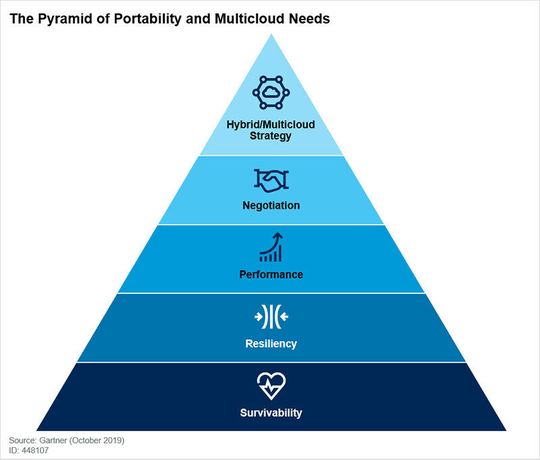

Die Gründe für die wachsende Popularität der Multi-Cloud sind anscheinend vielfältig. Der Verlust an Kontrolle über den Unterbau einer Bereitstellung zählt sicherlich mit dazu. Unerwartete Bedarfsspitzen durch die plötzliche Umstellung der globalen Wirtschaft auf Homeoffice setzten den Public-Cloud-Anbietern zeitweise schwer zu. Microsoft musste zwischendurch seinen Azure-Kunden die Zuweisung von Kapazitäten herunterschrauben, um die SLAs eigener Cloud-Dienste wie Microsoft 365 (Office 365) einhalten zu können.

Die zunehmende Akzeptanz von Cloud-Diensten hat sich auf die Dienstverfügbarkeit von Cloud-Anwendungen offenbar eher negativ ausgewirkt, enthüllt das Beratungsunternehmen KPMG im Bericht Cloud-Monitor 2020 in Zusammenarbeit mit Bitkom Research. Rund zwei von drei (67 Prozent) der befragten Cloud-Nutzer hätten in den vorangegangenen zwölf Monaten Ausfallzeiten ihrer Cloud-Lösungen erlebt. Dienstausfälle der Clouds müssen im Endeffekt ihre Nutzer ausbaden. Den Betroffenen steht dabei nur eine wirklich wirksame Gegenmaßnahme zur Verfügung: ein Failover auf eine andere Cloud. So bekommt die Multi-Cloud eine ganz „nachhaltige“ Existenzberechtigung.

Jedes dritte der befragten Unternehmen in Deutschland verzichtet stattdessen auf den Einsatz kritischer Anwendungen in der Public Cloud, enthüllt KPMG. Nur zwei von fünf Nutzern speichern in der Public-Cloud „kritische Informationen“. Im vergangenen Jahr ließe sich außerdem eine Zunahme von Herausforderungen der Integration von Public-Clouds in die bestehende IT-Infrastruktur feststellen.

Viele Clouds und keine Kontrolle

Mit einem Multi-Cloud-Ansatz verfolgen die Unternehmen mehrere Ziele: die Gewährleistung einer verbesserten Dienstverfügbarkeit, die Optimierung der eigenen Kostenstruktur und verbessertes Risikomanagement in Bezug auf das Vendor-Lock-In. Damit dies auch klappt, bedarf es einer einheitlichen Plattform, die alle Umgebungen der Multi-Cloud umspannen kann. In vielen Organisationen habe sich stattdessen ein ganzes Sammelsurium von Cloud-Diensten verschiedener Anbieter in stark variierenden Nutzungsmodellen angehäuft, beobachten die Analysten Aleksei Resetko und Vladyslav Dunajevski von PwC Deutschland. Das Resultat seien erhöhte Kosten und Risiken sowie die Entstehung einer „Schatten-IT“.

Laut Erfahrungen der Unternehmensberatung PwC Deutschland greifen Unternehmen auf Cloud-Dienste oft planlos und ohne adäquate Risikoabschätzung zurück. So simple Hilfsmittel wie eine lückenlose Übersicht der genutzten Cloud-Lösungen würden in vielen Organisationen schlicht und ergreifend fehlen.

Die Orchestrierungs-Elite

Kommerzielle Multi-Cloud-Orchestrierer wie SAP Gardener, HPE Ezmeral, VMware Tanzu und IBMs Red Hat OpenShift können „flächendeckend“ Abhilfe schaffen. Sie haben Kubernetes um dringend benötigte Features erweitert und damit zur Multi-Cloud-Engine der Wahl aufsteigen lassen.

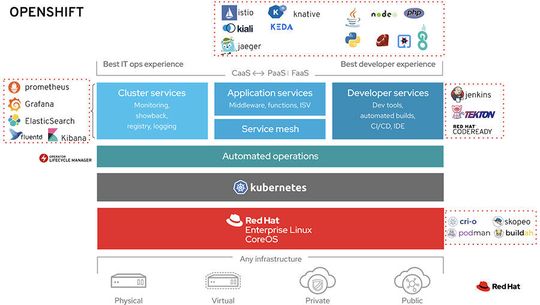

Red Hat OpenShift

IBMs Tochter Red Hat bietet mit der hauseigenen Cloud-Plattform OpenShift de facto eine eigene Kubernetes-Distribution. Sowohl bei Red Hat OpenShift als auch bei Kubernetes handelt es sich um eine Software zur Container-Orchestrierung. Red Hat OpenShift durchläuft bei Red Hat ausgiebige Tests und Optimierungen und beinhaltet zusätzliche Features, die in der quelloffenen Edition von Kubernetes nicht verfügbar sind.

HPE Ezmeral

HPE Ezmeral umfasst ein breites Portfolio von Technologielösungen zum „Agilisieren“ der Unternehmens-IT, allen voran:

- HPE Ezmeral Container Platform: ein Container-Orchestrierer auf der Basis von Kubernetes für Bare-Metal und VMs;

- HPE Ezmeral Data Fabric: ein verteiltes Dateisystem, welches Rechenzentren, Clouds und die Edge umspannt;

- HPE Ezmeral ML Ops: eine DevOps-Plattform für operatives ML, die sich hierzu eine Kubernetes-Infrastruktur aneignet;

- HPE Ezmeral IT Ops & Automation: KI-gestützte Automatisierungsplattform auf dem Unterbau von HPE OneView und HPE InfoSight;

- HPE Managed Cloud Controls: Überwachung der Kosten von Multi-Cloud;

- Security Software: Service-Authentifizierung in heterogenen Umgebungen auf dem Unterbau der CNCF-Projekte SPIFFE und SPIRE.

Ezmeral integriert Kubernetes mit anderen quelloffenen wie auch proprietären Lösungen, um eine Vielzahl von cloud-nativen wie auch Legacy-Arbeitslasten zu orchestrieren. HPE avisiert dabei Nutzungsszenarien wie Maschinelles Lernen, Analytics, IoT-Datenerfassung an der Edge, DevOps (CI/CD) und Anwendungsmodernisierung. In diesem Sinne soll HPEs Ezmeral Container Platform den Unternehmen helfen, auch ganz praxisnah „profane“ Herausforderungen der digitalen Transformation wie das Refactoring monolithischer Altlasten für cloud-native Umgebungen zu bewältigen.

In sein neues Ezmeral-Softwareportfolio ließ HPE die gebündelte Expertise aus den Übernahmen von BlueData (künstliche Intelligenz und Big Data), Scytale (Service Identity Management für cloud-native Services) und der kalifornischen MapR (cloud-nativer Datenspeicher) einfließen. HPE Ezmeral liegt der Gedanke zu Grunde, dass sich eine Softwarebereitstellung mit KI/ML/Big-Data-Aspirationen niemals in eine bestimmte Infrastrukturumgebung zwingen lassen sollte. Ob Bare-Metal-Clouds, virtuelle Maschinen (VMs) oder Container: Ezmeral kann jede Bereitstellung abdecken.

Die Ezmeral Container Platform (ECP) bringt einen vorintegrierten Data-Fabric-Service mit. Die HPE Data Fabric ist ein global verteilter Datenspeicher, der sowohl das Rechenzentrum als auch die Cloud umspannt. Der Data Fabric-Service erlaubt die persistente Sicherung des Datenspeichers einzelner Container und des gemeinsam genutzten globalen Speichers der Container-Bereitstellung. Die HPE Data Fabric bietet im Grunde genommen die gleichen Features wie auch Kubernetes selbst, jedoch mit dem entscheidenden Unterscheid, dass sich der Datenspeicher der Bereitstellung beim Einsatz der HPE Data Fabric selbst als ein Kubernetes-Workload ausführen lässt.

Mit dem integrierten Data-Fabric-Service hat HPE die üblichen Probleme im Zusammenhang mit der Bereitstellung von stateful-Anwendungen auf Containern mit Zugriff auf gemeinsam genutzte Daten behoben. HPE möchte mit dem Ezmeral Data Fabric die Verwaltung und Bereitstellung datengesteuerter Anwendungen vereinfachen und Migration von Daten und Workloads zwischen lokalen und Cloud-Umgebungen erleichtern.

Das Ezmeral-Portfolio von HPE deckt Container-Orchestrierung, KI/ML-Workloads, Datenanalyse, Cloud-Überwachung, IT-Automatisierung und AIOps Vorgänge sowie Cybersicherheit ab -– ein Rundumglücklich-Paket also.

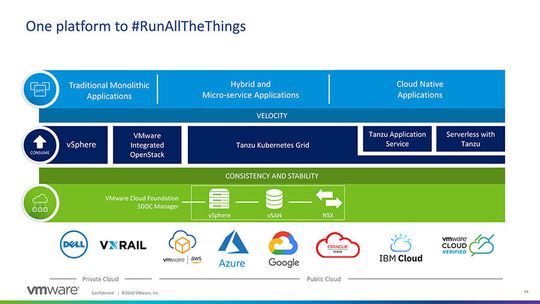

VMware Tanzu

Mit einer Reihe strategischer Übernahmen hat sich VMware in kürzester Zeit an die vorderste Front der Anwendungsentwicklung katapultiert: Wavefront (2017), Heptio (2018), Bitnami (2019) und schließlich Pivotal (2019). So wandelte sich VMware von einem „reinen“ Virtualisierungsanbieter zu einem Multi-Cloud-Spezialisten.

Tanzu ist VMwares hauseigene Implementierung einer Kubernetes-Plattform für die Multi-Cloud. Sie besteht aus drei Funktionalitätsbereichen („run/build/manage“): einer Kubernetes-Runtime namens Tanzu Kubernetes Grid, einer Build-Engine und einer Suite von Management-Diensten. Mit Tanzu möchte VMware alle Anwendungen unter einen Hut bringen – von traditioneller Software über cloud-native Microservices bis hin zu SaaS – und auf beliebigem Infrastrukturunterbau orchestrieren. Dabei stehen die Herausforderungen der Anwendungsmodernisierung im Vordergrund.

Das Tanzu-Portfolio setzt sich aus vier Grundelementen zusammen, die ineinander reifen:

- Tanzu Application Catalog: Mit einer unternehmenseigenen Bibliothek an vertrauenswürdigen quelloffenen Containern sollen Cloud-Nutzer ihre Softwareentwicklung beschleunigen können;

- Tanzu Build Service: Ein deklarativer Ansatz soll die Erstellung, Bereitstellung, Administration und Governance von Containern im großen Maßstab unterstützen;

- Tanzu Application Service: Dank der automatisierten Steuerung des Lebenszyklus von Anwendungen kommen Cloud-Nutzer in den Genuss einer nie dagewesenen Simplizität der Softwarebereitstellung;

- Tanzu Observability von Wavefront: Unternehmen erhalten vollständige Einblicke in Metriken, Logs und die daraus resultierenden Erkenntnisse über den ganzen Querschnitt des Stacks von der Infrastruktur- bis zur Anwendungsebene hinweg.

Mit einem Administrationswerkzeug namens VMware Tanzu Mission Control sollen die Nutzer von VMware sämtliche Kubernetes-Cluster verwalten können unabhängig davon, wo sich diese befinden, ob im unternehmenseigenen Rechenzentrum oder in der Cloud. Tanzu ist ein Zugeständnis an die Realitäten der Softwarebereitstellung in der Multi-Cloud. Denn die Modernisierung von Arbeitslasten erledigt sich nicht einzig und allein durch die Modernisierung der „bloßen“ Code-Basis, sondern muss vielmehr den Infrastrukturunterbau der Laufzeitumgebung mit einbeziehen. VMware hat dahingehend beachtliche Arbeit geleistet und die erworbenen Technologien beispielhaft miteinander verzahnt.

SAP Gardener

Unternehmen, denen eine Multi-Cloud mit deutscher Technologie vorschwebt, werden in der Metropolregion Rhein-Neckar im Baden-Württembergischen Walldorf fündig. Dort wächst und gedeiht mit SAP Gardener eine ausgereifte Kubernetes-Lösung, deren Support bodenständig deutsch ist. Ein tiefes Verständnis für die Anforderungen von hauseigenen Lösungen wie SAP S4 HANA gehört bei SAP selbstredend dazu.

Bei Gardener handelt es sich im Wesentlichen um einen Kubernetes-nativen Server für Erweiterungs-APIs, der mit einem Paket benutzerdefinierter Controller daherkommt. Kubernetes (K8s) unterstützt das Einrichten eines solchen Servers für die Aggregationsschicht, damit Nutzer den Kubernetes-eigenen API-Server um zusätzliche Schnittstellen erweitern können – nämlich um APIs, die zu der Standarddistribution nicht dazu gehören. Das erlaubt es wiederum, Kubernetes zum Beispiel in neue Umgebungen zu integrieren.

SAP Gardener beinhaltet ein vollständig validiertes Erweiterungsframework, welches sich an jeden beliebigen programmatischen Cloud- oder Infrastrukturdienst anpassen lässt. Gardener kann derzeit den gesamten Lebenszyklus konformer Kubernetes-Cluster auf AliCloud, AWS, Azure, GCP, OpenStack, Packet, MetalStack und vSphere in einer As-a-Service-Bereitstellung mit minimalen Gesamtbetriebskosten verwalten. SAP nutzt Gardener für die Bereitstellung von Kubernetes-Clustern auf AWS, Azure, GCP, AliCloud und OpenStack. Auf Gardener laufen bei SAP so diverse Arbeitslasten wie SAP HANA und andere Datenbanken, Big Data-Anwendungen wie SAP Data Hub, IoT-Workloads, KI/ML-Lösungen wie SAP Leonardo sowie serverloser Funktionscode und eine Vielzahl von Geschäftsanwendungen. SAP Gardener findet auch bei anderen Kubernetes-Nutzern großen Zuspruch. So nutzt zum Beispiel die Finanz Informatik Technologie Services GmbH (FI-TS) die SAP-Plattform Gardener als einen Managed Service von Kubernetes in Deutschland für ihre Kunden aus der Finanzbranche.

SAP Gardener bildet das Herzstück der SAP Cloud Platform Extension Factory/Kyma runtime, ein vollständig verwalteter Service für Kyma auf der Basis von SAP Gardener. So können Unternehmen im Rahmen der SAP Cloud Platform neben Cloud Foundry und der ABAP-Runtime (kurz für Advanced Business Application Programming oder deutsch Allgemeiner Berichts-Aufbereitungs-Prozessor, eine SAP-eigene Sprache der höheren Ebene) auch Kubernetes-gestützte Bereitstellungen verwalten.

Fazit

Container-Orchestrierung in der Multi-Cloud ist der Heilige Gral der Workflow-Bereitstellung. Das Resultat daraus ist eine florierende Kubernetes-Landschaft unter der Haube kommerzieller Cloud-Management-Tools. In turbulenten Zeiten sind clevere Strategien des Risikomanagements gefragt. Kommerzielle Multi-Cloud-Orchestrierer bieten die nötigen Voraussetzungen, um Agilität und Betriebssicherheit unter einen Hut zu bringen.

* Das Autorenduo Filipe Pereira Martins und Anna Kobylinska arbeitet für die Beratungsgesellschaft McKinley Denali Inc. (USA).

(ID:47159090)

:quality(80)/p7i.vogel.de/wcms/82/86/8286fd31176d5220aa1e74c91fc0f37b/0131566295v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dc/95/dc9550fef4f57bfb9f4e3c9fc51a61e4/0131288696v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/7e/fd/7efd2e9b411124327d48e0485f3dd672/0131034056v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/7d/177d30220ff049cef6886f93145fb9cf/0130502021v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a2/b8/a2b837e5e3d05cafd7548ba7ee6bd202/0131644876v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/4b/f1/4bf1a3bd9ae7d3295b9778777778e7a8/0131618739v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/f8/35f888b6d65302d7cfcae3fd92a6275d/0131526366v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/45/03/45032eed1497d2a265cfe4b5bbbad41c/0131502709v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/e1/0ce138b9cefbbfc389906d96e0e6a714/0131519002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/88/4a/884abbb47d508501cc9ffab8aa53eb07/0131627248v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/9b/289bec6b165001f56a197e344d452c54/0131549908v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/67/58679931a48101fb68b407bfd61aea2a/0131238283v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/70/cb/70cb450ae0e584e396ed20dfc6d79d88/0131655927v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/09/db095f25191e84c84dc523e2411f70fa/0131647678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/60/c660cf26f6e1800fb38b10ed9a2dbfd6/0123133958v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e6/34/e6345c4d141a90828818dc5266184766/0131363751v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5a/20/5a20ffd78f2a2321f17d6e916cd1d5fa/0131509980v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/97/6697d2841451cb18003ced1d8bb8aba2/0131601665v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/01/0e019b13b1de825a4b95d11ffa5fef92/0131511514v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/33/933353b22de87bcfd102d2e4a9024d3d/0131648849v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/a1/24a1948da83d14f3fa543be572cd775c/0131563331v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/e7/6fe76d13a37f2cc3f2ed73f2789961ac/0131511795v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/22/af22800f380e76ec67c005fa7969e365/0131563403v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/27/a7/27a7104edbb050dc7d49706d340491d8/0131145395v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/9f/959fad5a466b768557959a18f07d9af5/0130911962v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/6b/0c6b3a1666e14bbb5689595ae7bb394f/0131514664v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/9f/479fcbf7268b4f40c4dc5e197ab2e3ac/0131390571v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e6/6d/e66d351eb1b98a19c26b97215e2d464c/0131292922v2.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/7000/7040/65.jpg)

:fill(fff,0)/p7i.vogel.de/companies/62/b5/62b593179dd3e/enreach-logo.png)

:fill(fff,0)/p7i.vogel.de/companies/69/2e/692ecb7bb8f78/xopero-logo-color.png)

:quality(80)/p7i.vogel.de/wcms/67/5e/675e4e3cc6fa38ad9be6e4d5885e1dd1/0126385041v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3f/02/3f0211ef80a002d581ba3974c26c22c6/0130876455v1.jpeg)