Channel Fokus: Backup & Disaster Recovery Vorbereitet auf das Katastrophenszenario

Zugegeben: Die Bedrohung durch eine Alien-Invasion klingt reißerisch und scheint wenig wahrscheinlich. Im grauen Alltag geht es eher um Ransomware-Angriffe, die aber mindestens genauso dazu imstande sind, für einen hohen Puls bei den IT-Verantwortlichen zu sorgen.

Anbieter zum Thema

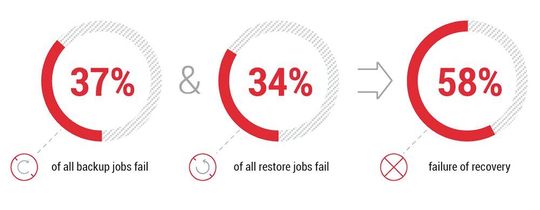

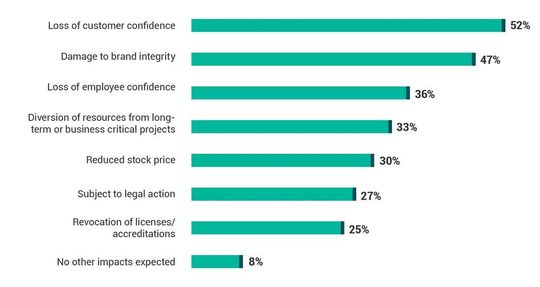

Das Prinzip Hoffnung stellt keine Backup-Strategie dar. Das 3-2-1-Prinzip (drei Kopien auf zwei Arten von Speichermedien, davon eine räumlich getrennt) hingegen schon. Hinzu kommt eine zeitliche Komponente, um im Notfall auf frühere Stände ohne mitabgespeichertes Ransomware-Problem zurückgreifen zu können. Archivierung steht auf einem ganz anderen Blatt geschrieben und wird getrieben von unterschiedlichen Aufbewahrungspflichten für verschiedene Arten von Daten, denn im Datenschutzrecht geht eine Aufbewahrungspflicht auch mit einer Löschpflicht nach deren Ablauf einher. Disaster Recovery hängt eng mit diesen Themenkomplexen zusammen und zielt darauf ab, dass nicht nur Daten wiederhergestellt werden, sondern im Katastrophenszenario auch möglichst schnell die Produktivsysteme, die damit arbeiten. In kaum einem anderen Bereich in der IT können so teure Fehler gemacht werden, wie beim „Backup & Disaster Recovery“. Positiv formuliert: Hier wird Knowhow stets gut bezahlt, und für ausgereifte Lösungen ist immer Geld im Budget.

Megatrend: verteilte Daten

Die Markttrends in diesem Umfeld hat Santhosh Rao, Senior Research Director bei Gartner, für IT-BUSINESS herausgearbeitet: So geht der Analyst davon aus, dass Unternehmen zunehmend zu einem hybriden IT-Modell übergehen. Workloads sind folgerichtig über das Datacenter, die Public Cloud und die Edge verteilt, was dazu führt, dass der Schutz der Workloads unabhängig vom Standort entscheidend ist. „Backup-Anbieter adressieren dies, indem sie Management-Plattformen offerieren, die entweder im Hauptrechenzentrum oder in der Public Cloud über gehostetes Backup as a Service bereitgestellt werden“, so Rao.

Die Ransomware-Problematik

Die Zunahme von Ransomware-Angriffen habe dazu geführt, dass die meisten Anbieter inzwischen die Erstellung unveränderlicher Zweitkopien von Backups durch WORM-fähigen (Write Once, Read Many) Speicher unterstützen.

Im Gegensatz dazu zielen beispielsweise IBM und Rubrik darauf ab, das primäre Backup-Repository durch die Unterstützung unveränderlicher Snapshots widerstandsfähiger zu machen, erläutert der Senior Research Director.

Um Ransomware-Angriffe zu erkennen, werden große Änderungen an Dateisystemdaten verfolgt. Die meisten Anbieter zielen zudem darauf ab, den Wiederherstellungsprozess durch die Erstellung einer isolierten Testumgebung zu vereinfachen und eine saubere Kopie des Backups zur Wiederherstellung bestimmter Dateien bereitzustellen. „Solche Bemühungen sind aber überwiegend noch in Arbeit“, skizziert Rau den technologischen Status.

Notfallplan für den Fall der Fälle

Neben der Automatisierung sowie den Herausforderungen beim Datenmanagement in und mit der Public Cloud, sind für Christian Geilen, Manager Channels bei Rubrik in der DACH-Region, „gerade die zahlreichen Ransomware-Attacken der vergangenen Monate Hauptgrund dafür, diesen Aspekt der Unternehmens-IT neu zu bewerten“. Denn wurden die Backups durch eine Ransomware-Attacke verschlüsselt, kann es ganz schnell sehr kritisch werden. „Jedes Unternehmen braucht einen Notfallplan für dieses Szenario, und die Backup-Infrastruktur spielt dabei die entscheidende Rolle“, so Geilen. Häufig folge nach einer Lage-Analyse im Unternehmen die Erkenntnis, „dass die Modernisierungs- und Automatisierungswelle, die viele IT-Abteilungen erfasst hat, nicht im Bereich Backup & Recovery angekommen ist“, berichtet der Rubrik-Manager. Es herrsche jedoch eine zunehmende Investitionsbereitschaft, woraus sich spannende Betätigungsfelder für IT-Dienstleister ergeben.

IT-Dienstleister sind gefragt

Das Tagesgeschäft rund um die Ransomware-Problematik kennt Albin Brandl, Chef bei Brandl Systemhaus in Straubing: „Einigen unserer Kunden war nicht klar, dass eine reine Spiegelung des Systems keine adäquate Backup-Strategie darstellt. Nehmen Sie beispielsweise ein Ransomware-Szenario“, so der Firmengründer. Bei einem gespiegelten System habe man das Problem quasi doppelt beziehungsweise mehrfach. Vielmehr ist es nötig, Backups, beispielsweise Tages-, Wochen- und Monatsbackups, zu erstellen, um auf frühere Stände der Daten ohne das Ransomware-Problem zurückgreifen zu können.

In der Praxis gibt es allerdings mitunter Probleme bei vielen zu sichernden Dateien, das Backup in einer Nacht durchlaufen zu lassen. „Das hängt mit den Durchsatzraten zusammen, die mit der steigenden Anzahl an einzelnen Dateien schnell in die Knie gehen“, berichtet Systemhaus-Chef Brandl.

:quality(80)/images.vogel.de/vogelonline/bdb/1828500/1828578/original.jpg)

EfficientNodes

Software-Defined Archive für Partner der ersten Stunde

Absicherungen für Cloud-Anwendungen

Bei Gartner will man beobachtet haben, dass im Segment Infrastruktur damit begonnen wurde, SaaS-Anwendungen wie Microsoft Office 365, Google G Suite und Salesforce in die Backup-Strategie einzubeziehen. „Viele Anbieter stellen nun ein Office-365-Backup über Partner bereit oder entwickeln diese Funktionen intern. Die Sicherung von G Suite und Salesforce ist weitgehend noch in der Entwicklung“, so Rao zum Stand der Dinge.

Die meisten Anbieter, die im aktuellen Magic Quadrant für Backup- und Recovery-Lösungen für Rechenzentren von Gartner aufgeführt sind, unterstützen das Tiering von Backup-Daten in die Public Cloud, was der 3-2-1-Backup-Regel entgegenkommt und die Kosten für den Backup-Speicher reduziert. „Die am häufigsten unterstützten Cloud-Speicherziele sind Amazon Simple Storage Service (Amazon S3) und Azure Blob Storage“ berichtet der Gartner-Analyst. Die Backup-Daten sind in den meisten Fällen selbstbeschreibend. Wenn diese Daten und der Katalog vor Ort verloren gehen, kann also eine Instanz der Backup-Software neu installiert werden, und die Daten können in einem zweiten Schritt wiederhergestellt werden. „Einige Anbieter integrieren auch die Lebenszyklus-Richtlinien von Cloud-Anbietern, zum Beispiel die Datenmigration von AWS S3 zu Glacier oder Azure Blob zu Azure Archive Blob Storage“, berichtet Rao.

Datenhaltung: Endgeräte versus Cloud

Eine beschleunigte Verlagerung von Daten in die Cloud ist das Szenario, auf das sich Reseller vorbereiten sollten, ist Sergei Serdyuk, VP für Product Management bei Nakivo, überzeugt. Tendenziell wird ein immer kleinerer Teil der anfallenden Daten auf Endgeräten, Anwendungen und Verzeichnissen gespeichert sein. Der Rest wandert demnach in die Cloud.

Laut dem „Cloud Monitor 2021“ von Bitkom und KPMG lehnen nur noch drei Prozent der hiesigen Firmen die Cloud-Nutzung komplett ab. Der Rest setzt bereits auf eine Cloud-Infrastruktur oder plant, auf eine solche zu wechseln. „Daher empfehlen wir Resellern, ihr Angebot zu straffen und sich auf Datensicherungslösungen zu konzentrieren, die Cloud-Technologien integrieren und SaaS-Backup unterstützen“, so Serdyuk.

Hardware-Trends

Hyperconverged Infrastructure (HCI) und einfach zu bedienende Appliances sind für Tim Henneveld, Vorstandsvorsitzender der Tim AG, ein zentraler Einflussfaktor, wenn man die Hardware-Seite betrachtet: „Dabei sind die Anbindung an bestehende On-Premises und an Multi-Cloud Umgebungen sowie die Berücksichtigung sich ändernder Workloads ebenso wichtig wie der Schutz der Backupdaten vor Cyberattacken und Ransomware“, so Henneveld.

Bereitstellungsmodelle ändern sich

Das Gegensatzpaar „Cloud statt On Premises“ drückt sich auf Seite der Bereitstellungsmodelle für Backup- und Desaster-Recovery-Lösungen in „Abo statt Kauf“ aus. Unternehmen, die in die Public Cloud migrieren, finden im abonnementbasierten Modell einen einfacheren Weg, um Backup-Lösungen zu beschaffen. Zwar ist diese Herangehensweise im Vergleich zur unbefristeten Lizenzierung nicht unbedingt günstiger, aber sie ist berechenbarer und einfacher zu verwalten, heißt es aus dem Hause Gartner.

„Virtualisierung und Container“ bilden als teilweise gegenläufige Technologie-Ansätze ebenfalls verschiedene Wege ab, auf die sich Anbieter von Backup und Disaster-Recovery-Lösungen einstellen müssen. So unterstützen die meisten Anbieter die sofortige Wiederherstellung von virtuellen Maschinen, indem sie die gesicherte virtuelle Maschine über das Network File System direkt auf den Produktions-Host aufsetzen. „Virtuelle Maschinen können damit sofort verfügbar sein, während der eigentliche Wiederherstellungsprozess im Hintergrund eingeleitet werden kann“, erläutert hierzu der Gartner-Researcher Rao. So oder so ähnlich bieten Anbieter wie Actifio, Cohesity und Rubrik eine sofortige Wiederherstellung von Datenbanken wie Microsoft SQL und Oracle.

Container-Technologie

Was die Container angeht: Sie zählen ebenfalls zu den großen IT-Trends dieser Monate und Jahre, was daher auch am Thema Backup nicht spurlos vorbei geht. So hatten einige Anbieter angekündigt, Container-Backups zu unterstützen, indem sie diese Funktionen entweder durch Übernahmen oder native Integration in ihre bestehenden Plattformen integrieren. Gartner-Kundenbefragungen zeigen jedoch trotz des Container-Hypes ein eher geringes Interesse an Container-Backups. „Trotzdem gehen wir davon aus, dass deren Akzeptanz in den nächsten zwei Jahren steigen wird, da mehr Container mit persistentem Speicher zur Unterstützung von Produktions-Workloads eingesetzt werden“, blickt Rao voraus.

MSPs sind auf dem Vormarsch

Das Channel-Business tendiert indes hin zum Managed Service Provider. Um Sicherungskopien geht es hier nur selten, und wenn, sind diese eher Mittel zum Zweck, beziehungsweise ein kleines Zahnrädchen in einem komplexen System, das der schnellen Wiederherstellung des Geschäftsbetriebs dient. An MSPs gehen diese Kundenanforderungen nicht vorbei. Dann ist von Disaster Recovery as a Service (DRaaS) die Rede, mitunter auch von Recovery as a Service (RaaS). Auch Business Continuity as a Service (BCaaS) rückt in das MSP-Tagesgeschäft.

(ID:47392446)

:quality(80)/p7i.vogel.de/wcms/18/39/18395f3882e23a90a5df6aad288b8133/0129680689v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/7e/af7e2841e3378f8b6a9a98510b9aad14/0129262578v6.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/c2/24c27aeefdf93876a395faa9790e6e40/0128909922v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/53/9a/539a7369f3f6420e59149463d2a30c44/0128372174v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/ec/fe/ecfe55643e34c4df7711e2f74c38c205/0130019950v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b1/0a/b10a1728b28e31742863ab562d50b056/0129965504v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/27/2b/272b62983d0a3415d587865a293860c9/0129928655v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fd/dc/fddc45ab5876fc49006eed18974a5354/0129894054v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/fe/fefe13b694a97fb8d018bfce51f3da07/0129663066v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/56/58/5658f484549d6429affe87855e223c13/0130003608v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5c/ce/5cceb393d495f2f2ce78152f15958845/0130010811v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4f/d4/4fd4149be6102aa8bfb3d9f822475d5a/0130023833v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/72/71/727183ea49b98fa72296663d1be37977/0128954806v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c1/a3/c1a3659498ec8a8e5e26bb1d675b678a/0129616364v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/96/999696a435cfb0663d8c9674b0679753/0129841581v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/07/3b/073bb10fd3f0d100fe00d97be7b9ffef/0129979310v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f9/4a/f94a4ea9f415217aa3bf6d75b22a61a1/0129973776v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/78/a6/78a6c4609fd9d34ed94c00dac3f313b5/0129968453v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/1f/1b1f7f5d01a123ebc64ac68de32b47d1/0129818727v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2a/cb/2acb88a496ed471e2fc8a7aeab010d63/0129940952v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bd/d0/bdd06946a0828bfeed40fb5c40467761/0129431489v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/b1/0eb141c5d1b080d4e820e7400a881e98/0129921108v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8c/ac/8cac0d49b638941e9caf74512f129a57/0129417828v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c3/65/c36588a166c5c2f7f0df83dfdbc20612/0129675422v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4c/37/4c37426226cd459c6764e7640c40f225/0129726556v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/39/13/39139c4bd5f8770d4b6331f74880ae6a/0129590998v2.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/69/98/699837ff85e16/datacore-logo-700x700px.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/b9/68b9bb61e8f14/ic-logo-black-green.png)

:fill(fff,0)/p7i.vogel.de/companies/69/2e/692ecb7bb8f78/xopero-logo-color.png)

:quality(80)/p7i.vogel.de/wcms/05/09/0509dae6606ff6bf4316107e66d2bbfd/0123787872v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/48/bf48dc3f144a7b98be8d7e087986cdeb/0128108397v1.jpeg)