Künstliche Intelligenz und Prompting Mit Prompting-Techniken LLMs schneller und billiger machen

Anbieter zum Thema

Bekannte Sprachmodelle wie OpenAIs o1 oder Googles Gemini 2.5 kosten Rechenleistung, Trainingszeit und treiben die Latenz in die Höhe. Neue Prompting-Techniken sollen die Ausgabequalität verbessern, Antwortzeiten reduzieren und Nutzungskosten senken.

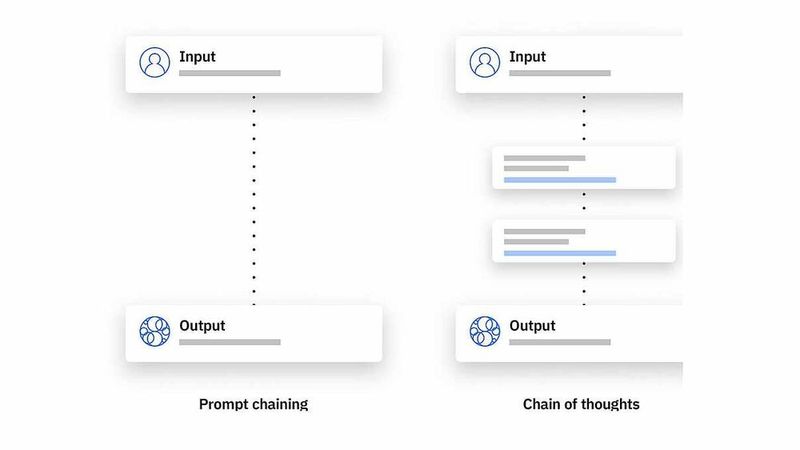

OpenAIs o1 und DeepSeek-R1 nutzen die Chain-of-Thought-Logik (CoT), um komplexe Probleme in Stufen aufzuteilen und so eine beispiellose Leistung sowie eine größere Genauigkeit als frühere Modelle zu erzielen. „Chain-of-Thought ist eine Prompt-Engineering-Technik, die die Ausgabe von LLMs verbessert, insbesondere bei komplexen Aufgaben mit mehrstufigem Denken“, erläutert Eda Kavlagoglu von IBM Research. „Es erleichtert das Lösen von Problemen, indem es das Modell mithilfe einer kohärenten Reihe von logischen Schritten durch einen schrittweisen Denkprozess führt.“

Aber CoT erfordert auch erhebliche Rechenressourcen während der Inferenz, was zu langen Ausgaben und höherer Latenzzeit führt, sagt Volkmar Uhlig, KI-Infrastruktur-Portfolio- Lead bei IBM, in einem Interview mit IBM Think.

Melden Sie sich an oder registrieren Sie sich und lesen Sie weiter

Um diesen Artikel vollständig lesen zu können, müssen Sie registriert sein. Die kostenlose Registrierung bietet Ihnen Zugang zu exklusiven Fachinformationen.

Sie haben bereits ein Konto? Hier einloggen

:quality(80)/p7i.vogel.de/wcms/dc/95/dc9550fef4f57bfb9f4e3c9fc51a61e4/0131288696v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/7e/fd/7efd2e9b411124327d48e0485f3dd672/0131034056v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/7d/177d30220ff049cef6886f93145fb9cf/0130502021v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/54/2f/542fa9acb82d3c328f073cc141aa056e/0130090354v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/f8/35f888b6d65302d7cfcae3fd92a6275d/0131526366v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/45/03/45032eed1497d2a265cfe4b5bbbad41c/0131502709v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/8d/06/8d06889fd4c403792c73e645c7a6afcb/0131432015v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/79/9e/799e4656759a9104d09ff1283328d519/0131375208v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cf/61/cf61072e7b289d0b1a91abb34a89c529/0131575406v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/72/26/722666c4082da83f9c09c66110800ca2/0131550436v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/18/0f/180fb8fe0f3423cef6b655ba7e44d7a3/0131547915v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/0d/b60d337c9f005102a0651a8ef2b0250f/0130632554v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8d/ee/8deeaa2c0404370512633f3a52f04d93/0131495748v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/f3/34f3a0dd5778340501875cc6a14278df/0131526337v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/a1/24a1948da83d14f3fa543be572cd775c/0131563331v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/d5/8ed55a513256a40422242a8906a0f714/0130664426v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/08/92083f78b862ac7cd00a863352bb1065/0131517318v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/7e/2d/7e2dc5b5422d3ab0b64d7de21b9424a6/0131532381v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f7/f1/f7f19dc34c3d31ac742bfe116ce0cf64/0131532147v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/6b/0c6b3a1666e14bbb5689595ae7bb394f/0131514664v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/9f/959fad5a466b768557959a18f07d9af5/0130911962v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/1f/d4/1fd4adf83bba8d1b4c9622dcf99945cb/0130972023v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/46/ba/46ba1db73d1dda26060868c1953d3a2f/0130518927v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/eb/91/eb9181205736edd8dbf0ce97003de026/0130669355v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/9f/479fcbf7268b4f40c4dc5e197ab2e3ac/0131390571v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e6/6d/e66d351eb1b98a19c26b97215e2d464c/0131292922v2.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/133500/133538/65.jpg)

:quality(80)/p7i.vogel.de/wcms/95/46/954646c31b77dba5388a3161f6305b1c/0125282828v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/67/1b/671b93b9cdadeb43032074d21894af19/0129119584v1.jpeg)